微软研究人员日前推出了名为 ZeRO 的新技术,用于优化在训练大型 AI 模型时,容易遇到的数据传输成本和带宽限制的难题,可显著减少大模型训练时间和成本。据悉,ZeRO 建立在现有的 ZeRO 传输技术基础上,并提供增强的通信策略,可提高训练效率,同时减少训练时间和成本。

▲ 图源 微软

为了减少参数通信量,ZeRO 可对权重进行量化,其利用基于块的量化方法来保持训练精度,这种优化的量化过程相对原始 Zero 传输技术更快更准确。为了能够尽量减少通信开销,ZeRO 通过在每台机器上保持完整的模型副本,以向 GPU 显存换取通信带宽。而在梯度通信方面,ZeRO 引入了一种名为 qgZ 的新的量化梯度通信方式,可以减少跨节点的流量和延迟。

▲ 图源 微软

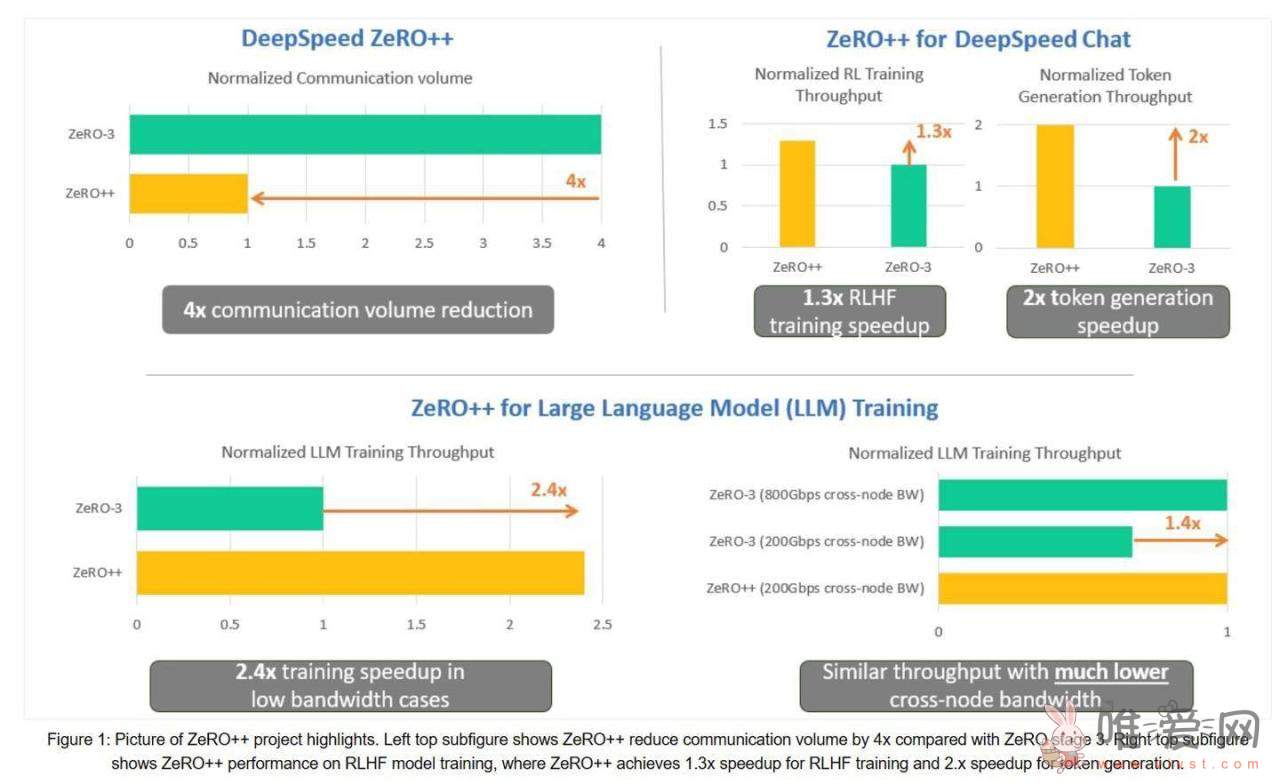

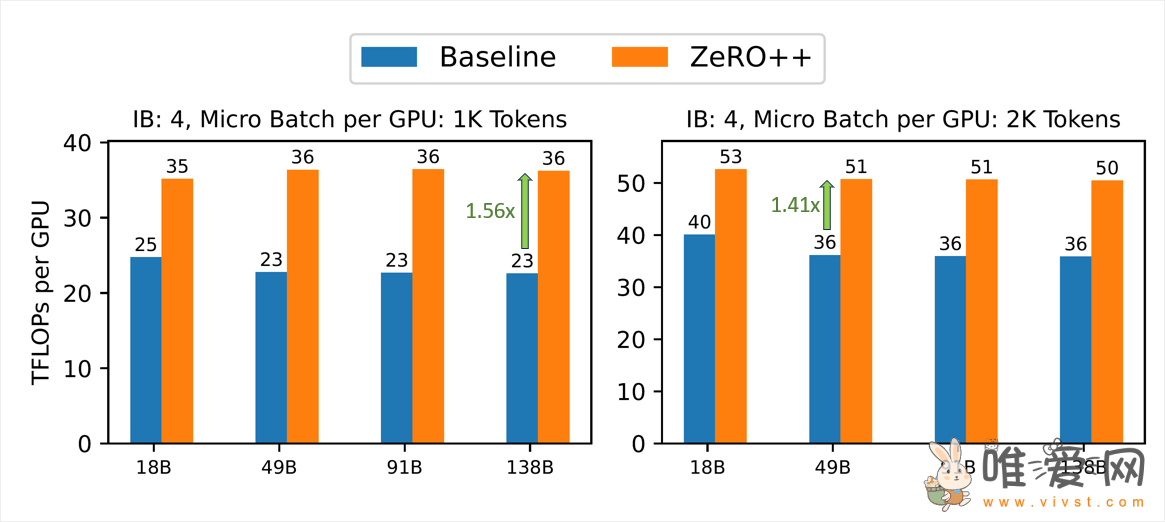

这些改进的通信技术大大减少了通信量,微软研究人员表示,与 ZeRO 相比,ZeRO 减少了高达 4 倍的通信量,提高了训练吞吐量和效率。当在每个 GPU 上使用小批量大小时,在高带宽集群中,ZeRO 相比 ZeRO-3 的吞吐量提高了 28% 至 36%。在低带宽集群中,与 ZeRO-3 相比,ZeRO 实现了平均 2 倍的加速,使得大模型训练在更多种类的集群上更为可行。

例如 Turing-NLG、ChatGPT 和 GPT-4 这样的大型模型,其训练需要跨多个 GPU 设备占用大量显存和计算资源,而 ZeRO 引入了通信优化策略,以克服在低带宽集群上进行训练时原有 ZeRO 传输技术的带宽限制。目前微软已经放出了相关技术文档,研究人员可以利用 ZeRO 更有效地训练模型,在 AI 领域探索新的可能性。

声明:本文内容采编自互联网,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容,请点击举报,一经查实,本站将立刻删除。